AI利活用に求められる人権への配慮とは?

需要予測、与信判断など、AIの活用領域が急速に拡大する一方で、性差別、ブラックボックス化した判断結果への反発など、さまざまな問題も浮上している。このような問題に企業はどのように取り組むべきか。AI原則の分析を通じ、AIと人権に関する国際的議論の動向を明らかにしたうえで、AI原則から企業がAIの開発・利活用において配慮すべき事項を導出するためのKGRIとの研究、NECのテクノロジー企業としての人権配慮の取り組みについて紹介する。

なお、本記事は、2021年3月、慶應義塾大学グローバルリサーチインスティテュート(KGRI)主催、NEC後援で開催された『ヒューマンライツと調和したAI利活用を考える』シンポジウムの内容を踏まえて作成している。

世界に広がる、AI原則の国際的議論

Web通販のマーケティングをはじめ、小売業の需要予測、車の自動運転、金融分野の与信判断など、AIの活用領域が急速に拡大している。

一方で、性差別による人事採用の欠陥、ブラックボックス化した人事評価への反発など、AI活用においてさまざまな問題も浮上している。さらに、ジェンダーや人種における差別に反対する声や動きが世界中で高まりつつある。

こうした状況のなか、世界ではAI原則に関する議論が活発化している。

「『原則』という意味を、AI利活用における共有すべき『価値観』と私はとらえています。AI原則に関する国際的議論が広がっていますが、その発端は2016年のG7における日本からの発信でした。」と語るのは、総務省情報通信政策研究所の特別研究員 高木幸一氏だ。

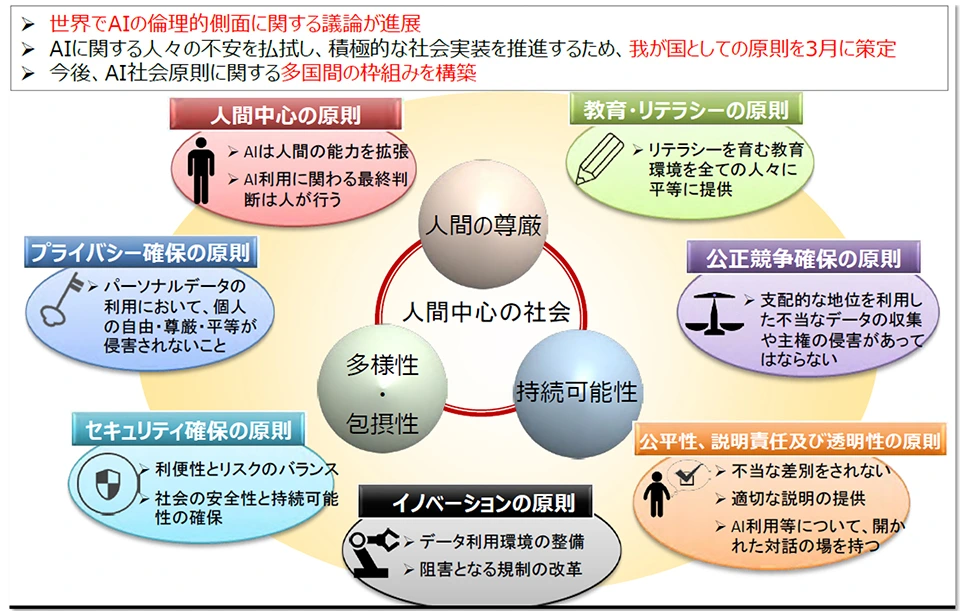

(引用)人間中心のAI社会原則会議(令和2年度第1回)資料2

https://www.cas.go.jp/jp/seisaku/jinkouchinou/r02_dai01/siryo2.pdf

AI原則のベースとなる価値観として、人間の尊厳、プライバシー、アカウンタビリティなどの重要性は、欧州委員会、OECD*、IEEE**で、ほぼ共通しているという。日本では、2019年3月、人間中心のAI社会原則として7つの原則を策定し、これをもとに各省庁がガイドラインなどの取りまとめを行っている。

たとえば、総務省ではAI利活用原則として、適正利用、透明性、公平性など10の原則をガイドラインとしてまとめているが、AI利活用の目的や用途はさまざまであり、原則のすべてを満たすことは難しい。

そこで、高木氏はAI原則の適用において、2つのポイントを挙げる。1つは、優先する原則の取捨選択を関係者全体で議論し、みんなで共有すること。そして2つ目は、原則を「義務」ではなく、「価値の向上」ととらえること。こうした取り組みを自主的に実施することで、AIを活用した新たなサービスや業務に付加価値が生まれるという。

また、関西大学准教授の水谷瑛嗣郎氏は、AI原則を企業活動に組み入れるうえで、大切なのは理系領域と文系領域の融合だと、説明する。開発者の技術的な側面だけでなく、倫理や文化、社会学や法学、さらにはリスクマネジメントなど、さまざまな側面から多様な意見を取り入れ、対話を重ねることで適正な利活用が可能になるという。

- * OECD:Organisation for Economic Co-operation and Developmentの略。37か国が加盟する経済協力開発機構

- ** IEEE:Institute of Electrical and Electronics Engineersの略。人類社会の有益な技術革新に貢献する世界最大の専門家組織

AI原則の紐解きによる、企業のAI開発・利活用における「配慮事項」の導出

NECは、AI開発・利活用を推進するなかで、AIと倫理に関して専門的な知見を有するKGRIに調査研究を委託し、きたるAIネットワーク社会に備え、プライバシー・反差別・個人の自律といったヒューマンライツの理念をAIネットワークシステムにあらかじめビルドインしておくことを目指し、その意味や具体的実装のあり方について、法学的・技術的に検討している。

「AIと人権の関係性に対するKGRIの研究活動は、NECからの委託によって2018年からスタートしました。技術によって人権をいかに保障、実現できるかという視点から研究を進め、2019年にはAIの社会実装における配慮事項をまとめました」と、KGRI副所長である慶應義塾大学 法務研究科教授の山本龍彦氏は、研究活動の経緯を説明した。

山本 龍彦 氏

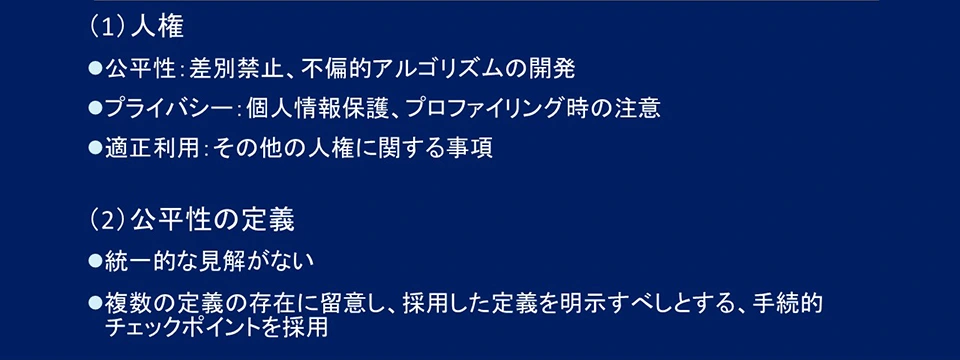

KGRIの研究成果として、AI開発・利活用の配慮事項の報告を行ったのは、九州産業大学講師の瑞慶山広大氏である。この配慮事項は、OECD、欧州委員会、IEEEの報告書を参考にして、AIの開発・利活用の配慮事項を2019年4月にNECが発表した「NECグループ AIと人権に関するポリシー」の7項目に分類してまとめたものだ。

配慮事項の取りまとめに際し、KGRIの研究会では抽象的なAI原則を憲法学的な観点から具体化し、さらにNECから現場視点での意見を受け、わかりやすさの点にも留意したという。

「今回作成した配慮事項は、一企業が負う内容としてはハードルが高い部分もありますが、AI開発・利活用が個人・社会に与えるインパクトや企業の社会的責任の大きさを踏まえて提言しています」と、瑞慶山氏は説明する。

この配慮事項やAI原則を具体化するアプローチに関して、現在、日本でのAI利活用の現場では、人権などの倫理的側面をどのように考えているのだろうか。

「従業員の人生に深く関わる人事データを扱ううえで特に重要なのは、AIは従業員の評価や昇進などを直接的に判断するツールではないという点です。現在は、人材の退職・活躍などの予測に加え、人材のタイプに応じたコミュニケーションやマネジメントのアドバイスなど、リコメンド型のサポートなどにもAI活用が広がっています。今回の配慮事項やAI原則を具体化するアプローチは、人事データを扱う際の指針としても有用だと思います」と話すのは、人事データの活用による経営改革の普及・推進を目指す一般社会法人 ピープルアナリティクス&HRテクノロジー協会の研究員である藤澤優氏だ。

また、投稿コメントの健全化に向けてAIを活用しているのが、Yahoo!ニュースだ。寄せられる投稿のなかには、不適切なコメントも多く含まれる。そこで同社では、ポリシー違反の投稿内容をAIが判断して、不適切コメントを削除している。また、違反の多い投稿者には注意メッセージを送り、不適切投稿の事前抑止にもAIを役立てているという。

同社の品質管理・シニアエキスパートの今子さゆり氏は、次のように話す。

「コメント欄は、自由な言論空間でもあります。そのため、AIの判断だけに依存せず、人間の目で確認するなど、投稿コメントと人権とのバランスを考えた適正利用が、つねに求められます。そうした点からも、今回の配慮事項やAI原則を具体化するアプローチは、有用だと思います」

さらに、AI研究者の視点から、理化学研究所の荒井ひろみ氏は、「AIによる意思決定において例えば適正さの確認のために個々に人間の介入をするには時間もコストもかかってしまう。企業内で配慮事項や基本ルールをあらかじめ定めることによって、判断コストを下げることも期待できるのではないか」と話す。

NECのテクノロジー企業としての人権配慮の取り組み

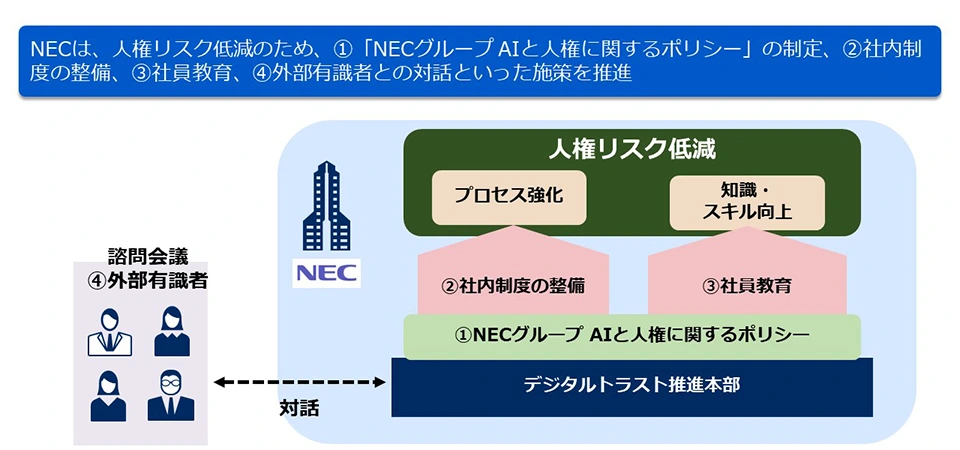

AI開発や利活用のベンダーであり、今回KGRIに配慮事項の作成を依頼したNECが、AI社会実装に向けて行っている取り組みについて、NEC デジタルトラスト推進本部の鮫島滋が語った。

先進のAI技術で社会課題への貢献を目指すNECでは、説明する責任をかねてより重視し、ホワイトボックス型のAI研究・開発にいち早く着手。現在、鉄道、電力、製造など、社会のさまざまシーンで実装されている。また、2021年3月には、宇宙船開発におけるNECのAIの本格導入が発表された。

社会に受容されるAIの提供に向けてNECでは、2019年に公平性、人権、プライバシーなど憲法的な価値を重視した7項目のポリシーを策定した。

また、NECでは人権へのリスク低減に向けた社内制度の整備、社員教育、外部有識者との対話、100項目以上におよぶAI品質ガイドライン策定、社外の人材育成など、さまざまな活動に取り組んでいる。

「NECでは、AIと人権に関する課題に対して、専門部署(デジタルトラスト推進本部)を設置。“NECグループAIと人権に関するポリシー”を策定して、社員一人ひとりが、企業活動のすべての段階において人権の尊重をつねに最優先なものとして念頭に置き、それを行動に結びつけるためにAIと人権に関するガバナンス構築を進めています。今回KGRIに提言いただいた配慮事項を重要なインプットとして人権やプライバシーに配慮した製品・サービスを提供するよう努めていきます」と、鮫島は語る。

鮫島 滋

「AIと人権に関する課題の理解や取り組みの重要性については、AI利活用を検討する社員を含めて社内の関心は高まっています。社会課題への貢献を目指しているNECでは、KGRIとの研究活動や今回のようなシンポジウムの開催を通じて、このような課題に今後も積極的に取り組んでいきたいと考えています」と、AI技術やサービスの提供ベンダーとして、NECの鮫島は締めくくった。