世界中で制定が進むAI関連法制にいかに対応するか

企業に求められる深層理解とプロジェクトの進め方

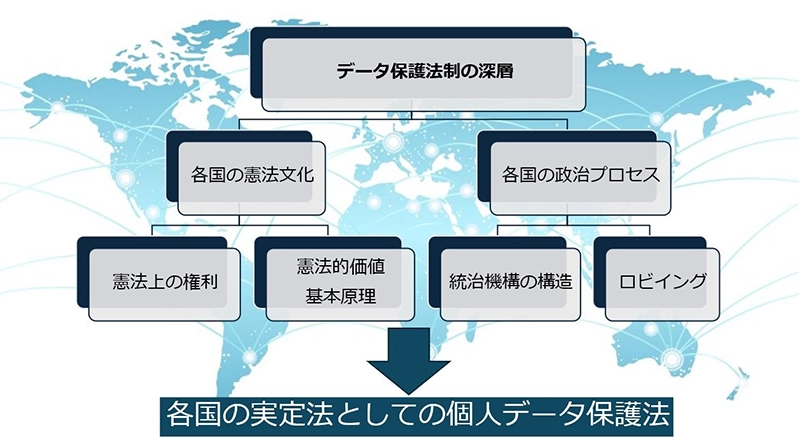

さまざまな分野でAIを活用したイノベーションが次々と生まれています。同時にAIによる差別やプライバシー侵害の発生を抑止し、AIを正しく活用するために、世界中でデータ保護法制やAI法制の制定が進んでいます。AIを活用する企業は、これらの法制を正確に理解し、適切に対応しなければなりません。慶應義塾大学 グローバルリサーチインスティテュート(KGRI)とNECは、2018年から共同研究に取り組み、各国家・地域の憲法ないしは憲法文化を基に、各国のデータ保護法制の背景にある基本的な考え方や政治プロセスを調査・分析。その成果をシンポジウムで発表しました。テーマは「個人データ保護のグローバル・マップ~憲法と立法過程・深層からみるプライバシーのゆくえ~」です。

AI利活用のために必要な法制度理解の視点

ローン審査や採用選考での性別や人種差別、本人同意のない行動や趣味・嗜好の把握、国家による監視の乱用など、AIの誤用による差別やプライバシー侵害などの問題に対する意識が高まっています。そのような問題の発生を抑止するために、世界中で個人データ保護法制やAI法制を制定する動きが加速していますが、その動きは目まぐるしく、まさに「アジャイル」に変化しています。対応を求められる企業および担当者の中には、このような変化にどのように対応すればよいのか、不安を抱いている人も少なくないのではないでしょうか。

「不安を払しょくするには、その本質を理解するのが重要。具体的には、対象となる国家や地域の個人データ保護法制の背景にある、基本的な考え方や政治プロセス(立法過程)を理解することです。それによって不安は和らぎ、アジャイルな変化を日常的に追いかける苦労は軽減されるはずです。基本的な考え方を知れば、変化することのない法制の深層や本質をつかむことが可能。そして、政治プロセスを知れば、変化の方向性や可能性を先回りして予測することができるからです」と山本龍彦氏(慶應義塾大学)は言います。

各国・地域のデータ保護法制と憲法の関係を調査・分析

シンポジウムでは、データ保護法制と憲法との関係について、カナダ、EU、ドイツ、アメリカ、日本のそれぞれの担当者が調査・分析結果の報告を行いました。概要は以下の通りです。

・カナダ(山本健人氏・北九州市立大学)

カナダ憲章にはプライバシー権の規定はなく、プライバシー保護の議論は、主に憲章8条(何人も不当な捜索及び押収を受けない権利を有する)を中心に行われています。個人情報保護法は、裁判所によって、憲法価値の実現と強い関連性をもつ準憲法的法律として認められています。

・EU(堀口悟郎氏・岡山大学)

EU基本権憲章では、プライバシー権の明確な規定があり、個人データの保護について独立した条文もあります。人間の尊厳や個人の自律性・主体性についても憲法の基本原理として存在します。GDPRやAI法は、こうした憲法の基本原理を具体化するものと位置付けられています。

・ドイツ(新井貴大氏・新潟県立大学)

ドイツの基本法には、プライバシー権の明確な規定はありませんが、1条1項(人間の尊厳)、2条1項(人格の自由)を組み合わせることで一般的人格権として解釈されています。1970年以降、データ保護法の制定が進み、1983年連邦憲法裁判所は情報自己決定権を一般的人格権に位置付け、憲法上の基本権として承認しました。

・アメリカ(瑞慶山広大氏・九州産業大学)

アメリカ合衆国憲法にはプライバシー権の明確な規定はありません。連邦制のため、州の権限が強く、カリフォルニア州やコロラド州ではデータ保護法が成立していますが、連邦レベルの包括的なデータ保護法は存在しません。国家からの自由としての表現の自由、民主主義、人種的平等の価値が重視されています。

・日本(田中美里氏・成城大学)

日本国憲法にはプライバシー権に関する明確な規定はありません。ただ個人情報保護法は、基本理念として「個人の人格尊重」に言及しています。令和4年改正以降には、ここでいう「個人の人格」に「プライバシー」が含まれるとの理解が示されました。憲法13条のプライバシー権の理解を踏まえた個人情報保護法の解釈が求められています。

EUを例に比較調査の意義を説明

例えば、EUのGDPRやeプライバシー法制は非常に有名ですが、その深層には「人間の尊厳」や「個人の自律性・主体性」にかかわる憲法の基本原則があります。EUの憲法とされる基本権憲章は、「個人データの保護」を明文化しており、GDPRを含む個人データ保護法制は、この基本権の具体化立法として位置付けられているのです。

「EUでは、個人は自律的・主体的に意思決定できる存在であるべきという考えや、国家は民間企業による基本権侵害から個人を保護する憲法上の義務を負っているという考えが強い。前者は、個人データに関する自己決定モデルと密接に関連し、後者はGAFAMのような民間プラットフォーム企業に対する比較的厳格な規制スタンスに結びついています」と山本龍彦氏は言います。

個人データ保護法制が制定される政治プロセスも、その国家・地域の憲法秩序や憲法文化によって変わります。EUには、各加盟国から選出される欧州委員によって構成される欧州委員会があります。法制化には、5年に1度の直接選挙で選ばれる欧州議会の承認が必要とはしているものの、法案提出権を独占するなど、欧州委員会が立法過程において大きな存在感を発揮しています。

「欧州委員会がEUの立法過程において強いリーダーシップを発揮できる背景には、選挙を気にすることなく、大きな理念的ビジョンを追求できるから。それが、基本的人権への影響を考慮した中長期的な視点でデジタル政策を展望するという強みになっています」と山本龍彦氏は言います。

AIの社会実装に向けて意識すべき2つの領域

シンポジウム後半で行ったパネルディスカッションでは、NECは、AIの社会実装を担う企業の立場から、プロジェクトを進める際に意識すべきことについて提言を行いました。パネリストは、尾崎愛美氏(筑波大学)、三澤真明氏(日本大学)、徳島大介(NEC)、山本健人氏、若江雅子氏(読売新聞)で、コーディネーターは山本龍彦氏です。

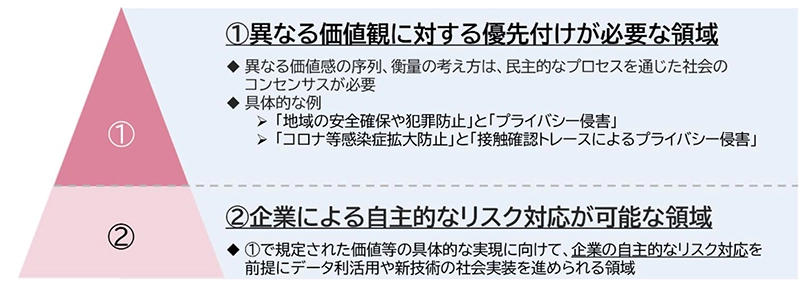

AIを活用したプロジェクトでは、プライバシー侵害のリスクに対処しつつ、技術の利用に関して適切なルールを整備し、運用しなければなりません。既存の法制度で明確なルールが示されていない場合は、自主的にルールを策定する必要がある場合もあります。「企業がルールを策定する上で意識しなければならないのは、人権を侵害する可能性のあるリスクを正しく特定できているか、また、リスク対応に関するルールを企業が中心になって決めることに問題はないのか、といったことです。これらを意識しなければ、良かれと思って進めたプロジェクトが社会的な批判を受ける可能性もあります。『地域の安全のための画像解析』と『プライバシー侵害』など、相反する価値観が存在し、利害関係が複雑な場合は、さらなる配慮が必要になります」と徳島大介(NEC)は言います。

このことを踏まえると、企業が社会的に受容されるかたちでAIを実装していくには、企業が主体的に決められる領域、みんなで決めなければいけない領域を正しく理解しておくことが重要になります。そして、企業が主体的に決められる領域であっても、決定した内容やプロセスは利害関係者に共有。また、みんなで決めなければならない領域では、積極的にルール形成に参加することが求められます。「2つの領域の線引きやルール形成への参画方法ついては、憲法学者、弁護士、規制当局などと引き続き意見を交わしていきたいと考えています」(徳島)。

また、パネルディスカッションでは、日本は、インターネット利用者のプライバシー保護が不十分ではないか、政策形成における透明性や多様性をより高めるべきではないか、市民が自分事としてとらえづらくなっているのではないかなど、日本の社会的課題についての指摘がありました。これらの課題を継続的に議論することは、AIの正しい利活用には重要です。

NECは、Principlesにも掲げる「人権の尊重」を最優先に、「NECグループ人権方針

これからもNECのPurposeである「安全・安心・公平・効率という社会価値を創造し、誰もが人間性を十分に発揮できる持続可能な社会の実現」に向け、人権尊重を最優先にした AI提供と利活用に取り組んでいきます。