デジタル維新—英雄たちの心のうち

シンギュラリティは来ない?カーツワイル博士が描くディープラーニングの世界観とは

Text:林 伸夫

コンピューターが人類の知的活動を凌駕する時代、「シンギュラリティ」の提唱者、レイ・カーツワイル博士はかねてからAIを「人工知能」と呼ぶのは適切ではないと発言してきた。(前編記事参照)人工的に算術計算したり、最適解をやみくもに覚え込ませたりするだけの「人工的手法」ではコンピューターに考える力を与えることはできない。自然界の音源をサンプリングして音を作るシンセサイザー、Kurzweil K250でやったように、自然界の事象が起こる仕組みを解明し、それをコンピューターが再構成する仕組みなら考える機械を作ることができるかも知れない。今の世界の進化をつぶさに分析していくと、脳神経の働きを真似ることで機械が自律的に学ぶ力を身に付けることができる。このまま世界が進化していけば、2045年頃には人間の脳の働きを超えていくかも知れないと予言したのだ。なぜ、計算や条件判断で推論を推し進めていく人工知能ではダメだと考えたのか? それは1980年代のカーツワイル博士の胸の内を覗いてみる必要がある。

林 伸夫(はやし・のぶお) 氏

1949年10月14日、山口県生まれ。1972年大阪大学基礎工学部制御工学科(現情報科学科)卒。1982年日経マグロウヒル社(現日経BP社)入社。ソフト評価委員会主宰、日経パソコン編集長、日経BP社システムラボ、日経MAC編集長などを歴任した。スティーブ・ジョブズ氏やビル・ゲイツ氏などIT業界の巨人に数多く取材をしている。

ボストンに単身カーツワイル博士を訪ねて

日経パソコンの立上げメンバーの一人として世界のコンピューター技術の動きをチェックしていた1984年のある日、「世界初!生の音源を使ったシンセサイザー誕生。音の操作はMacintoshで瞬時に可能」という情報をつかんだ。なになに? シンセサイザーって、その語源の通り音の波形は電気的に作り出すものじゃないの? 生の音源って、なんだ? しかも、そのコントロールはつい先日発売開始になったMacintoshでやるってどういうこと?

これは今度の『日経パソコン』の特集記事「世界のパソコン最新動向」で取り上げないわけにはいかない。カーツワイルの研究所と本社はどこなんだ? と調べたら、それはボストンの郊外。それならば取材先は決まった。MITのメディアラボのニコラス・ネグロポンティ所長とレイ・カーツワイル博士だ。

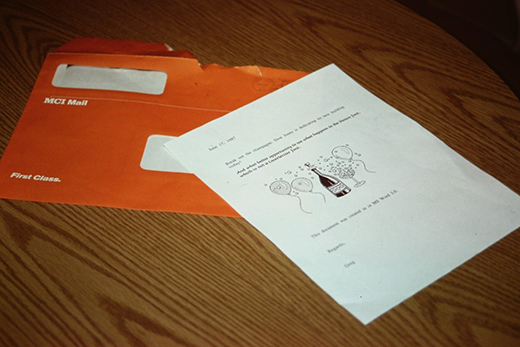

その昔、日本ではまだ電気通信事業法で禁止行為となっていたためインターネットもメールシステムもないころだ。そんな時代に即断即決、よくやったなあ、と我ながら感心する。取材先にはMCIメールという当時の電子メール配送サービスで取材依頼を送り、返事を待つ。常時接続の今のインターネットとは違い、返信があるかどうかは電話線でピポパと繋いでみなければ分からない。一日に何回も、何日も繰り返して1週間ほどで返事が来た!!! 「○月○日何時、研究室にお出で下さい」

こんなことをして世界を飛び回る国際ジャーナリストはその昔、数える程しかない。この取材のいきさつ裏話は書籍になったりASCIIの分厚い別冊になったり……。

なぜカーツワイルが人工知能ではなく知性の拡張を目指したのか?

カーツワイル博士の研究室に入ると、不思議な機械が所狭しと置いてあった。後に映画『バック・トゥ・ザ・フューチャー』にドクの研究室シーンが出てきた時には、そう言えばこんな感じだったなぁとニヤリとしたものだ。

既にその時には完成していた文字読み取り機(OCR)や文字を音声で読み上げてくれる「カーツワイル朗読機」を見せてもらった。その読み上げの滑らかさ。それは素晴らしいものだった。スピーカーから流れてくるのは人間が普通にしゃべっている会話の音声だった。当時、コンピューターの世界ではやっていたのはシンセボイスといって音素を人工的に作り出し、しゃべらせる技術。コンピューターが人工的な声でしゃべるものだから良く言えば未来的、意地悪く言えばこっけいな発音なのだ。それがまるで人がしゃべっているかのごとく聴こえるので驚いた。

「私の読み上げシステムは生の人の声を使っているのでこんなに自然に聴こえるのです」と博士は説明してくれたが、信じられないものがあった。今ではこの手法は比較的一般的に使われ、カーナビなどでは人気声優さんの声で話しかけてくれるものも一般化しているが、当時のコンピューター能力ではそんなことができるとは信じられなかったのだ。発音音素をばらばらに分解し、各子音、母音の再生のために再び合成し直す。う〜〜ん凄いわ!

続いて、カーツワイル博士自身が弾いて見せてくれたのが前編記事の冒頭の写真でお見せした新型シンセ、Kurzweil K250 だ。その音を聴いてまたぶっ飛んだ。まるで本物のスタインウエイのグランドピアノを弾いているかのような音が飛び出してくるではないか。続けて生ギターやバイオリン、しかもMacintosh画面をマウスでカチッとするだけで次々に重厚なサウンドが響いてくる。日本では400万円くらいで売り出されるらしいと聞いてはいたが、これなら音楽家は飛びつくのではないか、と思われた。

でも、なぜ人工知能を使った朗読機やデジタル文書作成機(OCR)を発明した人が楽器を作ることになったんですか? と聞いたら、ニヤリと笑って博士の持論が飛び出した。

「そもそも、僕の作っているものは人工的なんかじゃないですから。全部自然のもの。音声データは人の声、楽器の音素は生のスタインウエイのグランドピアノから注意深くサンプリングしたものです。音の発音機構は確かにスイッチとコンピューター上のアルゴリズムによる再構成ですが、自然界にあるものを忠実に再現しているものなんです。だから人工的、アーティフィシャルと呼ばないでほしいのです。最近AI、AIって言いますよね。アーティフィシャル・インテリジェンスの略ですが、私の目指しているのはアーティフィシャルではなく、知能を延長させるもの”Augmented Intelligence”なのです。」

スティービーの願いで生まれた楽器の基礎技術がディープラーニングへの伏線だった

「なるほど。それは深い話です。でも、なぜOCRを作っていたのに、楽器になるんですか?」

「実は、楽器を作ろうという話はスティービー・ワンダーから懇願されたからなんです。彼はテレビで私の作った朗読機を見たんですね。あ、彼は目が見えませんからその表現は良くないですね。聞いたんです。私の朗読機があまりに自然な人の声で読み上げるものだから、これで楽器もできるんじゃないか? と彼は考えたみたいです。ロサンゼルスのスティービー・ワンダーのスタジオに招待され、朗読機のことなどを説明するうち、それなら本物のグランドピアノの音を元に楽器を作れば素晴らしいものになるんじゃないか? ぜひ! 僕のために作ってくださいと」

「結局、それを開発することになりました。音作りはピアノの弦の鳴りかたを徹底的に解析、つまりリバースエンジニアリングですね。ハンマーが弦を叩く時にどんなエンベロープ(時間に沿った音圧の変化)になるのか、強く叩いたら? 優しく押し下げたら? フットペダルを踏み変えたら? それを徹底的に模倣しました。これには我々のコンピューターの演算アルゴリズムが活躍しました」

博士の持論は、こうだ。人間が動物の中でも特異的に知的能力が高いのは大脳皮質が極めて発達してきたから。恐竜の絶滅のあと哺乳類の時代がやってきた6500万年前から極めてゆっくりと進化を続け、50万年前ごろに人として大きく生活様式を変えていく。これには大脳皮質が深く畳み込まれてしわを刻みながら大きく拡大してきた進化に大きくかかわっている。そして、ある日、人は新たな知恵を獲得することとなった。そして、人の生活能力・思考能力は指数関数的に拡大していき、道具を獲得し、言葉を生み、新しいエネルギー源を生み出してきた。

人類の作り上げてきた技術も同様。毎年倍々ゲームで進化して行く。トランジスタのサイズ、処理能力、スピードなど暦年で見て行くと倍々で増えて行く。つまりその進化は直線的ではなく、指数関数的発展を遂げ、次の世代技術を生み出していく。真空管をどんどん小さくし、性能を高めていくといずれその容積に収まらなくなるが、その時にはそれを解決する半導体技術が生まれる。ロボットはどんどん小さくなって、いずれ血管の中を自由に航行する血球ロボットになり糖尿病やガンに立ち向かってくれるようになる。

コンピューター技術で実現する知性も脳神経のニューロンがどう信号を伝え反応するかをリバースエンジニアリングすることで解明できるようになる。今はようやくどんな物質が分泌されているのかを検出できるところまで来たに過ぎないが、この技術も指数関数的にレベルをあげ、その反応の意味を理解できる時が来る。リバースエンジニアリングして分かったノウハウをコンピューターで再現すれば脳の働きを拡張する知性が生まれる。そしてその知性が長い時間をかけて進化し、自分で学習する力を備え、自らを作り上げるところまで成長する。それがシンギュラリティだ。

シンギュラリティは来ない、と散々叩かれた

AI分野の研究は長らく「エキスパートシステム」と言われる仕組みが主流を占めた。80〜90年代、さまざまな問題に対する答えを用意してコンピューターに覚え込ませる仕組みが広く企業にも採用されるようになっていた。病気の症状に合わせて最適な薬を処方するといった応用分野ではかなり有効なシステムとして活躍もした。しかし、そのようなAIで人の脳を凌駕するような能力を持ったシンギュラリティの時代が来るのか、と問われたら難しいと言わざるを得ないだろう。いくら教えても教えてもとても追いつかないし、新しい問題が発生するごとに一から再教育しなければならないかも知れない。五目並べは教えられるかも知れないが、碁は教えられない。

こうしてAIは見方や応用分野によっては失敗、そんなAIがいくら進化していったところでシンギュラリティなんか起きっこない、と散々誹謗中傷された。しかし、カーツワイル博士の考えるAIすなわちAugmented Intelligenceは人間の脳神経細胞の働きを完全にリバースエンジニアリングして、コンピューターがその反応を再構成する仕組みを目指しているのだ。一旦は行き詰まってしまったAIもディープラーニングの手法がますます力をつけてくると、ブレークスルーを突破して「特異点(シンギュラリティ)」に到達すると信じている。

博士は自らの目でそのシンギュラリティを目撃することはできないかも知れない。だから、脳に電極を埋め、クラウドにバックアップを取り、来るべきシンギュラリティを目撃したいと考えている。