「AI 時代に変化する消費者意識調査」を

デジタルエシックス視点で読み解く 05

消費者の「便利だが不安」を信頼へ—

調査データ×有識者の示唆で描くデジタルエシックスのデザイン

AIやデータ活用は、もはや一部の先進層だけのものではありません。NECの「AI時代に変化する消費者意識調査」では、AI/パーソナライズ機能を体験した人が75%にのぼり、生活の当たり前になりつつある姿が見えてきました。一方で、利用者の多くはそれを手放しで歓迎しているわけではなく、「便利だが不安」という意見が66%という両価的な感情が主流です。

本連載の最終回では、第1〜4回の調査データで見えた「AIへ感じる不安」を、wisdom対談連載「有識者と語る10の視点」シリーズで語られた言葉と結びつけながら整理します。デジタルエシックスは守りのルールに留まらず、企業が意思決定し、設計・対話・発信を経て、新たな挑戦をするための指針です。

1. データから見えた「消費者と企業・ブランドの信頼関係構築を阻む3つのギャップ」

まずは、本調査を通じて明らかとなった消費者と企業・ブランドの間に存在するギャップや課題について、整理してご紹介します。

ギャップ1:AIの便利さは浸透したが、同時に不安が標準装備になった

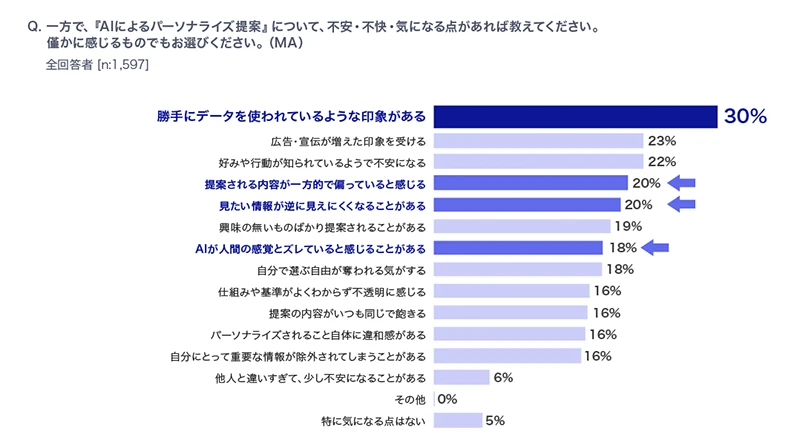

AIは便利である一方、勝手にデータを使われている感覚、仕組みの不透明さ、提案の偏りなどが不安を生んでいます。消費者はAIそのものより、「AIにどう扱われるか」で評価している—この構図が、第1回のデータからはっきり見えます。

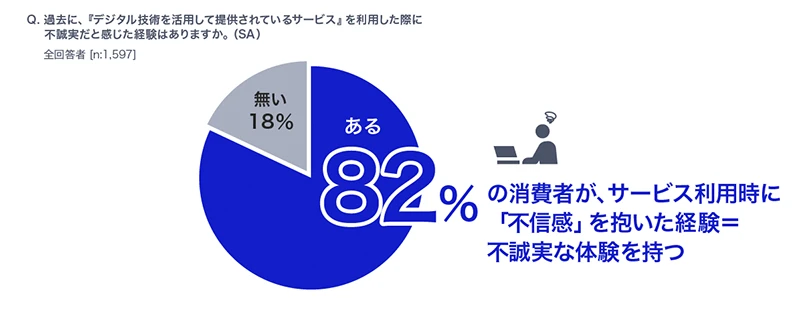

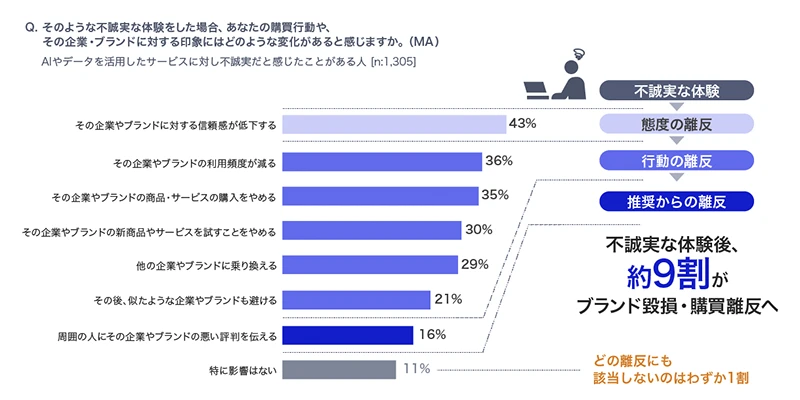

ギャップ2:不誠実な体験の増加により、企業・ブランドへの離反が発生

調査では、デジタルサービス利用時に「不誠実だ」と感じる体験をした人が8割超にのぼりました。透明性の欠如や、不親切なUX/UI(いわゆるダークパターンに近い体験)が、顧客の離反を引き起こします。離反は利用停止で終わらず、否定的発信を通じて拡大し得る—第2回で整理した「心→行動→言葉」という離反プロセスが、現実に起きています。

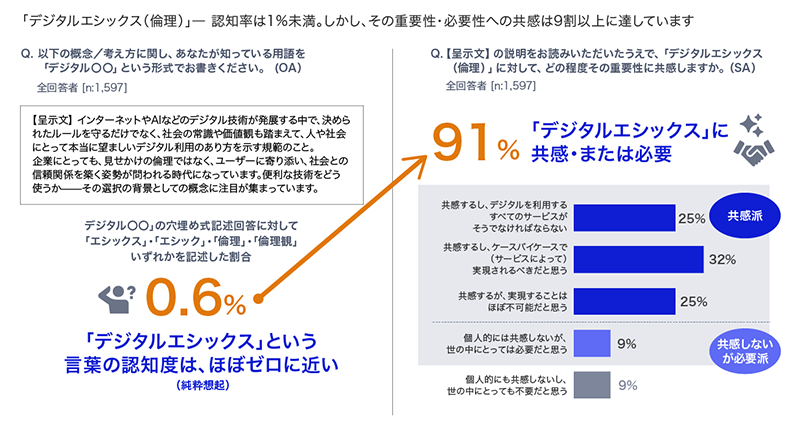

ギャップ3:大多数が「デジタルエシックスは重要」と共感しているが、「実装が見えない」

デジタルエシックスという言葉の認知は0.6%と低い一方、説明すると重要性への共感は91%にのぼります。しかし「利用中のサービスがデジタルエシックスを取り入れていると感じる」人は16%に留まります。需要はあるのに供給が追いつかない—信頼をめぐる最大の矛盾です。

ここまでのデータをまとめると、問いは一つに収束します。

「消費者の不安を解消して信頼を構築するにはどうしたらよいのか?」

2.なぜ信頼が積み上がらないのか—有識者の言葉で読み解く

調査結果を踏まえて2章では、信頼を積み上げる上で参考となる有識者の見解をピックアップし、その言葉からヒントを探ります。

AIが普及するほど、「正解」そのものよりも「決め方」が問われます。入山章栄氏(経営学者)が強調していたのは、まさにそこでした。

『AIが多くの仕事をこなす時代、人間側に求められるのは決断する力=意思決定力。そして、その意思決定を支える拠り所が倫理観であり、突き詰めれば、企業においてもデジタルエシックスは個人個人が持つべきものだ』という指摘です。便利なのに不安が消えないのは、消費者側が何を基準に判断すればよいかを掴めていないということです。

一方で、企業側にも分かっているのに動けない構造があります。名和高司氏(経営学者・コンサルタント)が語っていたのは、パーパスという言葉が流行する一方で、綺麗な言葉を掲げるだけでは実践につながらないという実態でした。そこで名和氏が提唱するのが、『パーパス(志)からプリンシプル(行動原理)を導き、それを日々のプラクティス(実践)へと落とし込んでいく。そして、その一連の流れの基軸となるのがエシックス(倫理)』という考え方です。そして、『組織がエシックスを軸として行動するために重要なのは、抵抗勢力でも先鋭でもない中間層であり、この人たちがプリンシプルを実践できるようにすることが組織変革の鍵になる』—この話は、重要性への共感が91%に対して実装が見えるのが16%に留まる現状を打破する示唆を与えてくれます。

さらに、消費者が企業を見る目は「理念」ではなく「行動」へ移っています。佐藤紀子氏(株式会社インターブランドジャパン)が象徴的に語っていたのは、『新型コロナウイルス以降、未来は簡単に予測できないという前提が強まり、企業は理念を語ること以上に、不確実な状況の中でどんな判断軸で考え、どう行動したかで評価されるようになった』という点でした。ここで鍵になるのは、なぜその判断・選択をしたのかを説明できること。裏を返せばやらないことを決めることでもあります。だからこそ、グレーな領域で議論が止まるのではなく、自分たちのエシックスがあるからこそグレーの中でも意思決定ができる、という状態をつくることが、信頼の前提になります。

そして松尾豊氏(東京大学大学院教授)の視点は、この「立ち止まりやすさ」を日本社会全体の課題として照らし出しました。法律・倫理は本来、技術の成熟とともに作り上げられるべきものですが、日本では『まだ決まっていないから、やらない』とブレーキになりがちだという指摘です。さらに、『新しい領域を探索するコストに対して社会がネガティブになり、挑戦を許容する余白が不足している。米国の著作権法におけるフェアユースのように、『目的や公共性・社会的意義に照らして妥当であれば一定程度は許容される、という判断枠組みがないことも、挑戦を立ち止まらせてしまう要因』だといいます。

ここで重要なのは、信頼と挑戦が対立しているのではなく、むしろ逆であることです。挑戦を成立させる設計が不足しているために信頼も育ちにくいと捉えることができます。「重要性は理解されているのに実装が見えない」というギャップは、こうした前に進むための枠組みが不足していることの反映とも言えます。さらに、『失敗する権利を奪ってはいけない』という言葉は、挑戦の余白を守ることが、結果として信頼とイノベーションの両方を生むという思想に通じます。

3.「後付け倫理」から脱却する:設計と実装の具体論

不誠実体験が広がる背景には、倫理を運用でカバーできるという誤解があります。しかし、ブライアン・フランセン氏(デンマークでデジタルエシックス基盤づくりに携わった戦略デザイナー)が強調していたのは、そもそも倫理は後付けできないという事実でした。

『製品開発は設計段階で意思決定の多くが決まる。だからこそ、倫理を最後に付け足すのではなく、最初から組み込む。しかも、デジタルエシックスはチェックリストではなく、複雑な状況で何を優先するかを見極める、どんな価値観で判断すべきかを考えるための行動原理だ』という発言は示唆的です。ダークパターンに近い体験の多くは、設計段階で倫理を考えられていないから発生してしまいます。

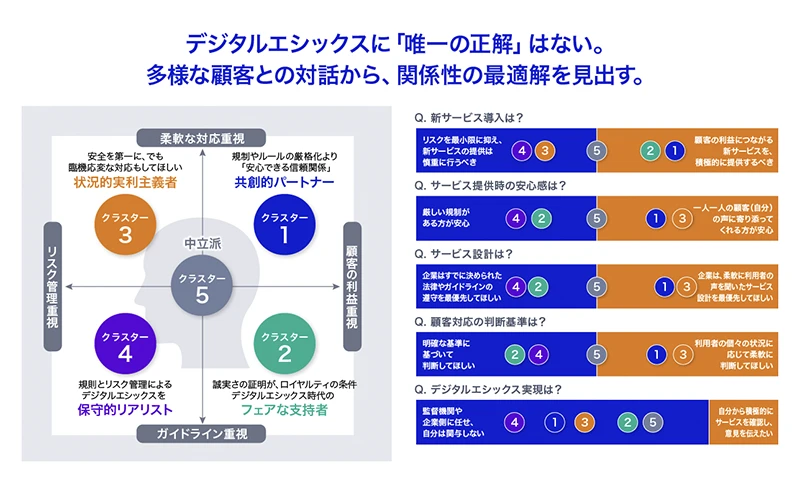

一方、価値観が割れる社会で必要なのは唯一の正解ではありません。谷内田修氏(前橋市の官民共創を推進)は、対話と合意形成を重ねて『納得解』をつくってきました。そこでは、『100%の正解を求めない』『多様なエシックスが存在することを認める』ことが前提になります。

第4回で示した5つのクラスター(共創、フェア、実利、保守、中立)は、まさに価値観が割れる現実を示しています。割れる前提で、納得できる道筋をつくる—合意形成を「プロセスの装置」として設計する必要があります。

さらに、信頼のつくり方は「基準」と「説明」のセットで成立します。村上明子氏(AI Safety Institute(AISI) 所長)が語ったのは、技術者自身が仕組みを理解し、安全性やリスクを言語化して社会へ発信する責任でした。加えて、イノベーションを止めないためには「上と下のライン」を定めることが重要だという提案もあります。『ここから先はやってはいけないという下限と、こうすれば実現しやすいという上限があるから、その間で安心して動ける。』これは、佐藤氏の『やらないことを決める』と同じ方向を向く「ガードレール」です。

松尾氏が提示した「けもの道」的な進め方は、このガードレールを現実に作っていく方法論として読めます。新しい取り組みを始める前に、法律家を集めて現行法の観点から整理や見解を示し、その上で中小企業が先行して実践・実績を積み上げ、一定の判断の蓄積ができた段階で大企業へと広げる。こうして慣習や判断基準を意図的に作り上げる。重要性は理解されているのに実装が見えない状況では、こうした地固めが前に進むための社会的説明可能性を生み、結果として信頼にもつながります。

4.人間中心を空疎にしない:メンバーシップと創造性、そして更新

信頼の議論が「企業内の正しさ」だけで完結すると、肝心の利用者に届きません。塩瀬隆之氏(京都大学 総合博物館 研究部情報発信系 准教授)が語ったのは、デジタルエシックスは「倫理を作るためのメンバーシップが不足している」という問題でした。『技術に詳しい人や既得権側だけで語れば、視野は狭くなる。たとえBtoBでもその先には一般消費者がいる以上、間に入る人を対話に巻き込み、関係性ごとデザインしていく必要がある』—この指摘は、第3回で示した「対話(共創)が推奨に効く」という結果とも重なります。

また、現場で起きるのは「技術の良し悪し」ではなく「価値観の衝突」です。櫻井大樹氏(アニメプロデューサー・脚本家)がアニメ制作のAI導入で見たのは、AIが便利かどうか以前に、導入が「現場の価値観を露わにする」という現実でした。『「残業は嫌だからAIにやらせたい人」もいれば、「教育を省くと人が育たないと主張する人」もいる。白黒がつけられない曖昧な中で指針になるのがデジタルエシックスであり、その曖昧さに向き合うプロセス自体が、信頼に直結していく。』第1回で示した「効率化(機能的便益)」だけでなく「体験の質(情緒的便益)」が好印象に効くという示唆は、人間らしさをどこに置き直すか、という問いにつながります。

落合陽一氏(メディアアーティスト)が示したのは、テクノロジー起点ではなく『ライフスタイル起点』で倫理を考え続ける視点です。

『どんな生活があり、そこにどんな課題が生まれるのか。その課題ごとに行動原理を問い直していく。倫理を固定ルールにするのではなく、関係者の対話と相互理解を重視する東洋的な規範と捉えて、状況に応じて更新していく』—価値観が多層化するいま、信頼は『固定より変容する倫理観』の中に宿ります。

そして松尾氏は、『ルール運用を厳しくする言説の方が説得力を持ちやすい』という現実に触れたうえで、ルールの本質に立ち返る姿勢の重要性を語っていました。『本来の目的を果たすために機能しているのかを問い、必要なら緩めることも是正することもある。』

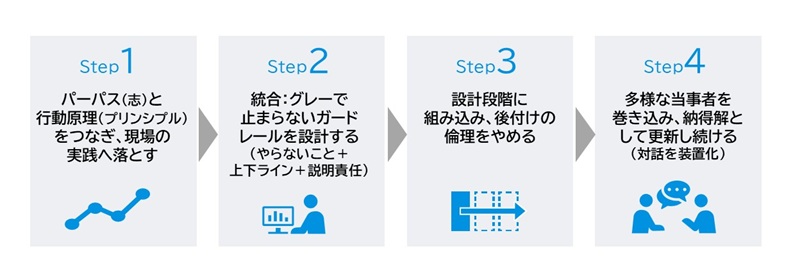

5.最終提言:デジタルエシックスを実装する4ステップ

第1章で見えた3つのギャップ(不安の標準装備/不誠実体験と離反/実装の不可視化)を埋めるには、理念を掲げるだけでなく、判断・設計・説明・対話を「仕組み」として回すことが必要です。以下では、各章で得た示唆を4つのステップに整理し、現場で再現できる形に落とし込みます。

Step1:パーパス(志)と行動原理(プリンシプル)をつなぎ、現場の実践へ落とす

パーパスは方向性ですが、現場が迷うのは「その場でどう判断するか」です。だからこそ、『パーパスからプリンシプルを作り、それをプラクティス(実践)へとつなげる(名和氏)』。その実践において、『決断する力を支える基準となるのが、倫理観(入山氏)』です。

Step2(統合):グレーで止まらないガードレールを設計する(やらないこと+上下ライン+説明責任)

『やらないことを決めることが選択となり(佐藤氏)』、『上と下のラインがあることで安心して動ける(村上氏)』。そして、そのガードレールを社会へ発信し続けることが不安を減らす。さらに「決まっていないからやらない」を越えるには、『目的や公共性、社会的意義に照らして妥当であれば一定程度は許容されるという枠組みづくりも欠かせません(松尾氏)』。

Step3:設計段階に組み込み、後付けの倫理をやめる

信頼は、運用で「頑張る」ほど限界が来ます。『倫理を最後に付け足すのではなく、最初から組み込む(ブライアン・フランセン氏)』ことが出発点です。加えて、『小さく試し、判断の蓄積を作り、事例を広げていくけもの道的アプローチ(松尾氏)』は、実装が見えない状態を突破する現実的な手順になります。

Step4:多様な当事者を巻き込み、納得解として更新し続ける(対話を装置化)

『価値観が割れる前提で、100%の正解を求めず納得解をつくる(谷内田氏)』。そのための『メンバーシップを丁寧に作っていく(塩瀬氏)』。『価値観が露呈する現場で建設的な未来を描く(櫻井氏)』。そして、『状況に応じて更新し続ける(落合氏)』。信頼の「完成形」ではなく、信頼の「更新力」を設計することが、AI時代の実装になります。

6.おわりに

デジタルエシックスは「不安をゼロにする」ための理想論ではありません。不安が生まれる前提で、判断軸・設計・対話・発信・挑戦の余白を仕組みとして組み上げるための実装論です。重要性への共感が91%にのぼる一方で、実装が「見える」のは16%。このギャップを埋めた企業から、消費者の「便利だが不安」は「便利だから信頼できる」へ変わっていくはずです。

調査・企画・執筆:NEC BluStellarブランドマーケティンググループ(吉見大輔、鈴木章太郎、若山拓巳、権田麻実)